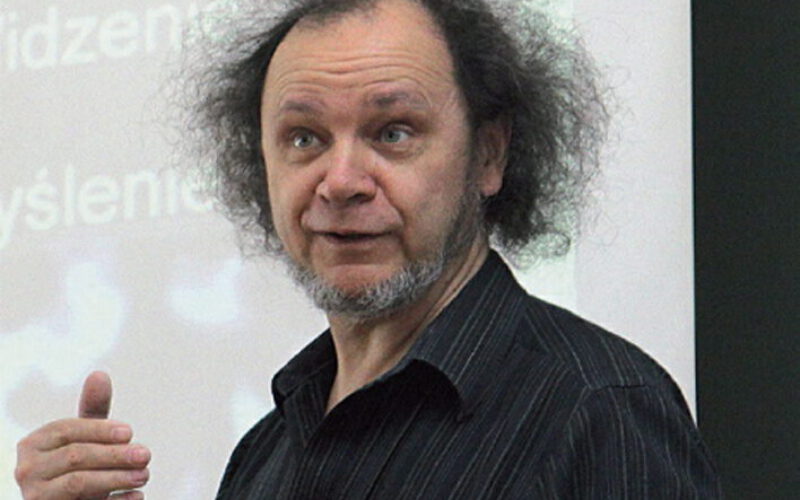

Dochodzimy do punktu, w którym sztuczna inteligencja bez szczegółowych instrukcji od człowieka jest w stanie zrobić wszystko Prof. Włodzisław Duch – kierownik Laboratorium Neurokognitywnego UMK Czy nasz umysł ma jakiekolwiek funkcje w zakresie uczenia się, analizowania danych lub podejmowania decyzji, których prawdopodobnie nigdy nie osiągną algorytmy sztucznej inteligencji? – Zdaniem wielu osób ludzki mózg jest tak skomplikowany, że niczego podobnego nie da się stworzyć za pomocą systemów elektronicznych. Zwracają oni uwagę, że praktycznie niemożliwe jest nawet modelowanie pojedynczego neuronu, będącego niesłychanie skomplikowaną infrastrukturą. Ale czy odwzorowanie tego, co robią mózgi, musi być tak szczegółowe? Wydaje mi się, że nie. Projektując samolot, dążymy nie do tego, aby był jak najwierniejszą kopią ptaka, tylko do tego, by potrafił podobne rzeczy. Współczesne sztuczne sieci neuronowe mogą tworzyć pewne ślady pamięciowe, które kojarzą ze sobą, jeśli podamy im odpowiednią wskazówkę, co stanowi bardzo dobre przybliżenie tego, jak działa nasza pamięć. Potrafimy szczegółowo symulować także pozostałe zasadnicze zdolności poznawcze mózgu, dlatego może się okazać, że krok po kroku będziemy w stanie odtworzyć wszystkie jego funkcje. Nie widzę żadnych barier, które mogłyby trwale zatrzymać rozwój sztucznej inteligencji na poziomie poniżej możliwości człowieka. Co więcej, w wielu obszarach dotyczących percepcji czy rozumowania już teraz jej kompetencje są nadludzkie. Na razie kiepsko daje sobie radę choćby z matematyką. – W wielu dziedzinach nie powstały jeszcze wyspecjalizowane systemy rozumujące, a systemy ogólne, takie jak GPT-3, są trenowane głównie na tekstach, dzięki czemu są w stanie prowadzić konwersację w sposób coraz bardziej podobny do człowieka. Gdy zadamy im trudniejszą zagadkę matematyczną, to trochę tak, jakbyśmy oczekiwali odpowiedzi od osoby, która ukończyła polonistykę albo historię. Nie potrafię wskazać jakiejkolwiek dziedziny wymagającej myślenia, w której odpowiednio nauczone systemy nie byłyby w stanie przekroczyć naszych możliwości. Aczkolwiek jest tutaj jeszcze sporo do zrobienia, dlatego że modele oparte na pamięci skojarzeniowej jedynie podsyłają nam różne możliwości, których poprawność musimy sami zweryfikować. Jednak i w tym możemy już liczyć na pomoc algorytmów, tzw. modeli neurosymbolicznych. Chyba nawet ważniejsza od odpowiedzi na pytanie o granice możliwości sieci neuronowych jest jednak inna kwestia: czy można stworzyć robota, który będzie jakoś odczuwał ten świat i samego siebie? Sztuczna inteligencja może być bowiem bardzo zaawansowana, a jednocześnie wcale nie musi być świadoma w takim sensie jak my. Ale doczekamy się i takich technologii? – Nie ma żadnych wątpliwości, że sztuczne systemy mogą być przytomne, czyli zauważać przedmioty znajdujące się w ich otoczeniu, reagować na różne polecenia itd. – wiele takich systemów już działa. Trwa natomiast dyskusja, czy mogą być samoświadome. John Locke, słynny filozof angielski, już 334 lata temu napisał, że istotą świadomości jest zdolność postrzegania tego, co dzieje się w naszym umyśle. To postrzeganie nie jest jednak jakąś abstrakcją, tylko fizycznym procesem, rozpoczynającym się od aktywowania śladów pamięci, które wytworzyły się w korze mózgowej w wyniku analizy informacji dochodzących ze zmysłów. Gerald Edelman, który dostał Nagrodę Nobla za odkrycia dotyczące układu immunologicznego, a później zajął się świadomością, nazwał ją zamrożoną przeszłością. Pobudzenie śladu pamięciowego sprawia bowiem, że mózg przyjmuje stan podobny do tego, w jakim znajdował się w momencie jego zapisywania, a następnie tak powstające skojarzenia próbuje interpretować. Analogiczne mechanizmy można zastosować w robotach, a już ze 25 lat temu wysunąłem argument, że jeśli stworzymy system, który będzie potrafił komentować przyjmowane przez siebie stany, trudno będzie mu odmówić pewnej formy świadomości. W dłuższej perspektywie zatem możemy projektować systemy reagujące w sposób nieodróżnialny od ludzkiego mózgu? – Tak, ale rzecz jasna nie musi to oznaczać, że ich świadomość będzie w pełni taka jak nasza. Sieć skojarzeniowa, która umie opisywać stany wewnętrzne, jakich doznaje w reakcji na bodźce, może nie mieć jakichkolwiek emocji, dążeń itd. Chyba nie można wykluczyć, że z czasem stracimy wyłączność nawet na poczucie humoru. – Parę miesięcy temu, dzięki rozwojowi wielkich sieci neuronowych, pojawiły się systemy, które potrafią analizować obrazy i na tej podstawie dokonywać niesamowitych rzeczy,