Technologie

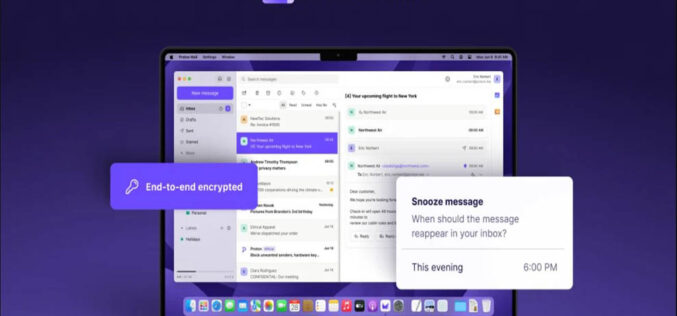

Kierunek na niezależność

Aby zerwać się ze smyczy amerykańskich gigantów cyfrowych, warto przejść na niezależny system operacyjny

Tworząc zestaw sprzętowy niezależny od big techów, można się poczuć jak cyfrowy rebeliant. Przesiadka na pojedyncze usługi dostarczane przez europejskie firmy to jedno. Ale zmiana całego systemu operacyjnego? To już brzmi abstrakcyjnie. W praktyce jednak okazuje się bardzo proste. Największą przeszkodą nie jest wcale brak alternatywnych rozwiązań. W publikacjach z poprzednich dwóch tygodni ustaliliśmy już, że dla każdej amerykańskiej usługi znajdziemy kilka europejskich zamienników. Największą przeszkodą jesteśmy my sami – nasze nawyki i wygodnictwo.

Komputer najbardziej osobisty

W tym tygodniu postanowiliśmy pokazać, że można wyjść poza systemy dostarczane przez amerykańskie korporacje. To trudne ze względu na nasze przyzwyczajenia. Myśląc o komputerze, myślimy o systemie Windows, niektórzy alternatywę widzą w sprzęcie z nadgryzionym jabłkiem w logo. Tymczasem do zerwania się ze smyczy gigantów wystarczy pendrive i nasz dotychczasowy komputer. Na początku wyjaśnijmy jednak, skąd bierze się tak silnie ugruntowane przekonanie, że nie ma życia poza dwoma amerykańskimi systemami od Apple’a i Microsoftu.

Ze statystyk portalu StatCounter wynika, że udział rodziny systemów Windows w polskim rynku wynosi ok. 81%. W całej Europie różne odsłony Windowsa znaleźć można na niemal 70% komputerów. Dużym graczem jest też system macOS firmy Apple. W Polsce udział komputerów z tym systemem to ok. 15-16% rynku. W Europie ta wartość również jest bliska 16%. Produkty Apple’a jawią się wielu użytkownikom jako ta „cool” alternatywa dla komputerów opartych na systemie Windows. Ale to tylko wrażenie, zbudowane przez lata sprytnego marketingu firmy – przypomnijmy sobie reklamę odwołującą się do „Roku 1984” Orwella.

Apple należy do ścisłej czołówki amerykańskich big techów. Pierwszą piątkę najwyżej wycenianych firm technologicznych w marcu 2026 r. stanowiły: NVIDIA (ok. 4,45 bln dol.), Apple (ok. 3,85 bln dol.), Alphabet (właściciel Google’a, ok. 3,7 bln dol.), Microsoft (ok. 2,99 bln dol.) oraz Amazon (ok. 2,25 bln dol.). Narzędzia Apple’a mają tę wadę, że tworzą hermetyczny ekosystem. Przeciwnicy firmy mówią, że to dobrowolne zamknięcie się w rezerwacie.

System Microsoftu króluje na rynku komputerów osobistych od lat. Jego pozycja jest niezachwiana bynajmniej nie ze względu na niezawodność. W latach 90. Windows zyskał popularność dzięki swojej otwartości – można było go zainstalować praktycznie na każdym komputerze. Decydującym czynnikiem był jednak pakiet Microsoft Office. W biurach na całym świecie szybko stał się standardem. Firmy masowo wdrażały Windowsa właśnie dlatego, że pracownicy znali już takie narzędzia jak Word, Excel i PowerPoint. A skoro cały ekosystem był popularny na rynku pracy i coraz powszechniejszy w domach, to także szkoły zaczęły go traktować jako standard. Dziś większość użytkowników nie wyobraża sobie alternatywy, bo Windows jest wszędzie, a tzw. niebieskie ekrany śmierci (BSOD – Blue Screen of Death – komunikat o krytycznym błędzie systemu Windows,

k.wawrzyniak@tygodnikprzeglad.pl

50 lat Jabłka

Apple to firma, której można nie lubić. Odcisnęła jednak piętno na elektronice, z której korzystamy na co dzień

Przez mrok biegnie kobieta z młotem w rękach. Gonią ją zamaskowani policjanci. Wokół szarzy ludzie. Wszyscy tacy sami, słuchają przemówienia lidera, które wyświetla się na olbrzymim ekranie. Kobieta wbiega do wielkiej sali i rzuca młotem w ekran. Wybuch. Jeśli komuś się wydaje, że to scena z filmu SF, nie myli się wiele. Lektor mówi:

„24 stycznia Apple Computer zaprezentuje Macintosha. Dowiecie się, dlaczego rok 1984 wcale nie będzie jak »1984«”. Na ekranie pojawia się tęczowe nadgryzione jabłko.

To reklama nakręcona przez Ridleya Scotta, reżysera takich klasyków jak „Obcy – ósmy pasażer Nostromo” czy „Blade Runner”.

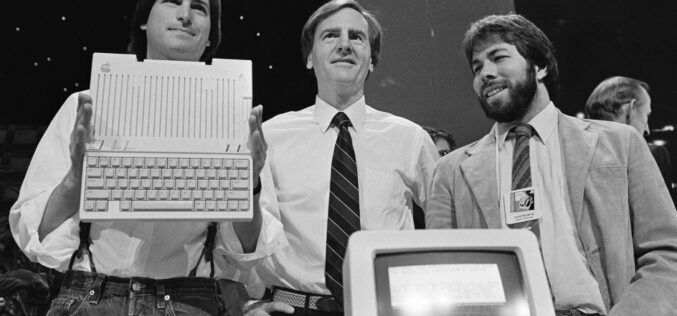

Komputery z garażu

Rzeczywiście rok 1984 był przełomowy w historii Apple’a. Zapowiadany Macintosh, choć nie imponował parametrami technicznymi, stał się hitem ze względu na użycie graficznego interfejsu i myszki. Komputery Apple’a dotarły do masowego użytkownika. To dało firmie chwilową przewagę na raczkującym rynku.

Jej początki sięgają jednak roku 1976, kiedy Steve Wozniak, Steve Jobs i Ronald Wayne zaczęli produkować komputery w garażu rodziców Jobsa. 1 kwietnia założyli Apple Computer Company. Wayne pewnie do dziś pluje sobie w brodę, bo szybko wycofał się ze wspólnego przedsięwzięcia, sprzedając swoje 10% udziałów za 800 dol. Obecnie Apple wart jest prawie 4 bln dol.

– Apple jest na rynku komputerowym, a w zasadzie technologicznym, od pół wieku. To ogromny przedział czasowy dla logarytmicznie ewoluującej branży. Na początku lat 70. komputer był kojarzony z wielkim urządzeniem zamkniętym w chronionych pomieszczeniach, z dostępem wyłącznie dla państwowych i wojskowych elit. Kontrkultura hipisów zainicjowała wielkie zmiany, dostrzegając również w komputerach narzędzia samorealizacji i wspólnoty z nieograniczonym dostępem do technologii. To na tym gruncie powstał w 1976 r. pierwszy komputer Apple-1. Jobs i Wozniak nie wynaleźli komputera osobistego, ale upowszechnili go i w maszynę wypełnioną krzemowymi czipami tchnęli ducha, wolność i sztukę – mówi Jacek Łupina, założyciel i kurator Apple Muzeum Polska, jednej z najbogatszych prywatnych kolekcji sprzętu, oprogramowania i artefaktów związanych z historią Apple’a.

Wizjoner marketingu

Czy najsilniej z Apple’em kojarzony Steve Jobs rzeczywiście był wizjonerem? Ilu użytkowników sprzętu Apple’a, tyle prawdopodobnie opinii na ten temat. Można jednak śmiało powiedzieć, że był bardzo utalentowanym marketingowcem, który wiedział, jak zaszczepić w klientach potrzebę kupowania jego wyrobów. Wróćmy do naszpikowanej odniesieniami reklamy z 1984 r. Młot rzucany w lidera symbolizował wyzwolenie od korporacyjnego konformizmu i totalitarnej kontroli Wielkiego Brata. Macintosh to bunt przeciw monotonii i ówczesnej dominacji komputerów firmy IBM, obietnica, że komputery osobiste niosą ludziom wolność.

Ten dryg marketingowy dostrzegany jest nawet współcześnie. „Reklama Apple: w nocy chłopaki dziewczynom robią fotki. Tacy są gładcy, młodzi i ładni, do tego różnorodni. Deskorolkami suną przez miasto, chcą mi coś udowodnić. Ja moim robię screenshot mema,

k.wawrzyniak@tygodnikprzeglad.pl

Concorde – reaktywacja

Ikoniczny samolot znów będzie przewoził pasażerów

Dokładnie pół wieku od daty pierwszego lotu rejsowego Concorde znów będzie przewoził pasażerów. Firma Fly-Concorde spełni tym samym marzenia milionów jego fanów na całym świecie, których dziadkowie i ojcowie rozkoszowali się widokiem pięknej podniebnej sylwetki.

Zmodernizowany i dostosowany do obecnych potrzeb lotnictwa Concorde wróci do latania najprawdopodobniej w pierwszej połowie 2026 r. Termin ten nie został wybrany przypadkowo – w przyszłym roku świat będzie obchodzić 50-lecie pierwszego liniowego lotu pasażerskiego tej maszyny.

Emblematyczny samolot wróci na trasy m.in. dzięki decyzji Donalda Trumpa. 6 czerwca br. na lotnisku w Waszyngtonie amerykański prezydent odwołał obowiązujący od 1973 r. zakaz lotów samolotów naddźwiękowych nad lądem. Jak podkreślił Michael Kratsios, dyrektor Biura Polityki, Nauki i Technologii Białego Domu, decyzja ta umożliwi Amerykanom podróżowanie z Nowego Jorku do Los Angeles w czasie krótszym niż cztery godziny.

Naddźwiękowy, drogi, ale bezpieczny

Decyzję tę natychmiast wykorzystała firma Fly-Concorde. Jej nowa maszyna na pierwszy rzut oka nie będzie wiele się różniła od powstałej ponad pół wieku temu. Przede wszystkim zachowana zostanie aerodynamiczna sylwetka przypominająca ptaka.

Nowy Concorde będzie jednak – czego oko laika nie zauważy – o 50% lżejszy od oryginału.

Jeszcze większe zmiany wprowadzono w zakresie emisji zanieczyszczeń. Będą one aż o 80% mniejsze niż w przypadku starego modelu. Silniki będą wyraźnie cichsze. Nowy samolot poleci na wysokości 18 tys. m, czyli znacznie wyżej niż inne popularne samoloty pasażerskie.

Oko zwykłego śmiertelnika zauważy za to zmiany we wnętrzu nowego samolotu. Jak zapowiadają jego twórcy, będzie ono niezwykle wytworne – oparte na japońskim minimalizmie. W kabinie pilotów zastosowano natomiast technologie kosmiczne – efekt wieloletnich badań i przygotowań.

Za reaktywacją słynnego Concorde’a stoi dr Pano Kroko Churchill, ekspert w dziedzinie fizyki, krewny premiera Wielkiej Brytanii Winstona Churchilla. Od lat skupia się on na badaniach dotyczących oddziaływania szumu samolotów naddźwiękowych na organizm człowieka. Prace nad najnowocześniejszymi silnikami naddźwiękowymi, którymi przewodził potomek premiera Churchilla, doprowadziły do zastosowania w nowym samolocie takich rozwiązań, że jego lot nad lądem nie będzie przeszkadzał mieszkającym 18 km poniżej ludziom.

Dr Pano Churchill to technologiczny weteran ponad

Komu służy sztuczna inteligencja

AI ma coraz większy wpływ na zmiany społeczne i na rynku pracy

Od miesięcy media wieszczą, że sztuczna inteligencja (Artificial Intelligence, AI) wyprze z rynku pracy kolejnych profesjonalistów. Ludzie nie lądują jednak masowo na bruku, jak straszy część nagłówków. Ale widać, że AI ma znaczący wpływ na światowe rynki pracy, dotyczy to również Polski. Sztuczna inteligencja to nowe możliwości w wielu zawodach, w które zresztą skutecznie się wdarła. Jednocześnie jest czymś nowym od strony społecznej. Jej oddziaływanie nie zawsze można nazwać pozytywnym. Dużo osób zaczęło korzystać z chatbotów AI w zastępstwie sesji terapeutycznych. Pisanie z botami AI jest też popularne wśród nastolatków, co w wielu przypadkach miało opłakane skutki.

Kto na bruk?

Rozwój sztucznej inteligencji nie jest dobrą wiadomością dla niektórych zawodów. Organizacja Współpracy Gospodarczej i Rozwoju już w 2024 r. prognozowała, że nawet 85% stanowisk kasjerskich może zostać zautomatyzowanych do 2030 r. Od kilku lat w dużych sieciach handlowych widać coraz więcej kas automatycznych. Tesco UK odnotowało 40-procentowy spadek liczby kasjerów od 2020 r. do teraz. Wiele sieci oferuje pracownikom możliwość przekwalifikowania się, m.in. na specjalistów ds. obsługi klienta lub operatorów logistyki. Alternatywą mogą być stanowiska związane z handlem internetowym lub obsługą magazynową zamówień składanych przez internet.

W nadchodzących latach niełatwo będą też mieć pracownicy administracji i księgowi. Według badań przeprowadzonych dla firmy konsultingowej McKinsey już dziś aż 50% zadań księgowych może wykonywać AI. Najnowsze systemy z wbudowaną sztuczną inteligencją potrafią automatycznie przenalizować faktury, wygenerować raporty, a nawet wypełnić formularze podatkowe. Prognozowany spadek zatrudnienia w tej branży to 15-20% do 2030 r. Dużo mniej zagrożeni mogą się czuć przedstawiciele zawodów medycznych, ale nawet tu przewiduje się zmiany. Dzieje się to zresztą w radiologii i diagnostyce obrazowej. Sztuczna inteligencja już teraz skutecznie wspiera część procesów diagnostycznych. Na szczęście zgodnie z ustawą o zawodach medycznych AI nie może diagnozować samodzielnie, bez nadzoru lekarza. Technologia ta odznacza się jednak dużą skutecznością. Algorytmy z precyzją wykrywają zmiany nowotworowe, anomalie neurologiczne i urazy.

Od początku rewolucji AI obrywa się natomiast branży kreatywnej. Eksperci Światowego Forum Ekonomicznego sądzą, że w jej przypadku do 2030 r. sztuczna inteligencja zastąpi człowieka nawet w 42% zadań. Z drugiej strony mówi się o nowej erze kreatywności. Artyści nie są jednak zachwyceni i pytają, komu służą te zmiany. Według brytyjskiego związku zawodowego pisarzy, ilustratorów i tłumaczy literackich Society of Authors tylko w 2024 r. 26% artystów straciło pracę z powodu rozwoju sztucznej inteligencji. 37% ankietowanych odnotowało zaś spadek dochodów. Słowem AI psuje artystom rynek.

Zmiany spowodowane przez AI widać coraz wyraźniej w wielu branżach. Według Światowego Forum Ekonomicznego do 2027 r. globalnie może powstać nawet 97 mln nowych miejsc pracy związanych ściśle z działaniem AI. Zatrudnienie znajdą analitycy danych i specjaliści, technicy ds. robotyki, trenerzy algorytmów i testerzy AI, doradcy etyczni ds. danych, edukatorzy cyfrowi i doradcy cyberbezpieczeństwa. W Polsce pojawiają się kolejne programy wsparcia i certyfikacji w obszarach związanych z AI. W tym zakresie szkolą już w PARP, GovTech czy NASK. Uczelnie i instytucje mają świadomość, że nowe zawody będą wymagały interdyscyplinarnych kompetencji: technicznych, społecznych i poznawczych. W mediach społecznościowych co chwilę pojawiają się zaś reklamy platform edukacyjnych, które zapraszają na warsztaty i kursy z zakresu obsługi AI.

Mój przyjaciel robot

Rynek pracy nie jest jedynym miejscem, w którym sztuczna inteligencja zmienia zasady gry. AI ma coraz większy wpływ na zmiany społeczne. Do niedawna narzędzia takie jak ChatGPT czy Gemini stanowiły jedynie źródło rozrywki, miejsce, gdzie można wygenerować obrazek lub zadać kilka pytań. Dziś wiele osób zdaje się na chatboty z wbudowaną AI nawet w kwestii terapii czy najintymniejszych zwierzeń.

– Krótko mówiąc, zaufanie do algorytmu bierze się z jego nieprzerwanej dostępności, braku oceny i iluzji pełnej kontroli. W sytuacji niedoboru psychologów i rosnącej presji społecznej ludzie traktują chatbota jak dyskretnego pierwszego słuchacza. Badania nad Repliką i Character.AI pokazują, że część użytkowników buduje z botem więź quasi-partnerską. To pomaga w sytuacji samotności, ale według mnie nie zastąpi głębokiej, dwustronnej relacji międzyludzkiej, bo jest oparte na iluzji – mówi filozofka sztucznej inteligencji i futurolożka prof. Aleksandra Przegalińska.

Podobnego zdania jest psychoterapeutka Katarzyna Kucewicz, która przy okazji zwraca uwagę na pewne niebezpieczeństwo płynące z zastępowania terapeuty sztuczną inteligencją: – Usługi psychologiczne są dziś drogie. Wymagają czasu i cierpliwości. Niestety, niezależnie od branży

k.wawrzyniak@tygodnikprzeglad.pl

Ludzka sztuczna inteligencja

Żadna inna technologia nie została zaprojektowana po to, by skopiować sam umysł

Jedną z najistotniejszych cech sztucznej inteligencji jest nie tyle to, co ona potrafi, ile w jaki sposób funkcjonuje w ludzkiej wyobraźni. W dziedzinie ludzkich wynalazków jest to sytuacja wyjątkowa. Żadna inna technologia nie została zaprojektowana po to, by skopiować sam umysł, dlatego jej tworzenie tak bardzo obrosło wyobrażeniami z pogranicza fantastyki. Gdyby naukowcy zdołali odtworzyć w komputerze coś podobnego do ludzkiej inteligencji, czy nie oznaczałoby to, że zdołają też stworzyć dzieło posiadające świadomość albo uczucia? Czy nasza istota szara nie jest po prostu bardzo zaawansowaną formą biologicznego komputera? Łatwo odpowiedzieć na te pytania twierdząco, skoro definicje „świadomości” i „inteligencji” są tak rozmyte, przed nami zaś otwierają się drzwi do ekscytującej możliwości: że tworząc AI, naukowcy tworzą w gruncie rzeczy nową żywą istotę.

Wielu naukowców, rzecz jasna, nie wierzyło, że o to chodzi, bo wiedzieli z własnego doświadczenia, że duże modele językowe – systemy AI, które wydawały się najbliższe skopiowania ludzkiej inteligencji – są budowane na zwyczajnych sieciach neuronowych trenowanych na olbrzymich ilościach tekstu, dzięki którym potrafią wywnioskować prawdopodobieństwo wystąpienia danego słowa czy wyrażenia po innym. Kiedy taki system „przemawiał”, przewidywał tylko, jakie wyrazy z największym prawdopodobieństwem powinny paść jako kolejne, bazując na wzorcach, które pokazano mu podczas szkolenia. Były to po prostu olbrzymie urządzenia prognostyczne albo, jak mawiali niektórzy badacze, narzędzia „autouzupełniania na sterydach”.

Gdyby to bardziej prozaiczne ujęcie sztucznej inteligencji upowszechniło się i stało się szerzej akceptowane, władze państw i urzędy regulacyjne wespół z opinią publiczną mogłyby w końcu wywrzeć większy nacisk na spółki technologiczne, domagając się, by ich przewidujące maszyny były bardziej sprawiedliwe i precyzyjne. Dla większości ludzi jednak zasady działania tych modeli językowych były czymś niepojętym i w miarę pojawiania się coraz płynniej działających i bardziej przekonujących systemów łatwiej było uwierzyć, że gdzieś w tle zachodzi jakieś magiczne zjawisko. Że może AI naprawdę jest „inteligentna”.

Noam Shazeer – ekscentryczny, legendarny badacz pracujący dla Google’a – po tym, jak wraz z innymi opracował transformator, wykorzystał tę nową technologię do stworzenia Meeny. Google zbyt się obawiał, że może ona narazić na szwank jego interesy, i nie wprowadził jej na rynek – gdyby się na to zdecydował, tak naprawdę udostępniłby całkiem przyzwoitą wersję ChatGPT dwa lata przed OpenAI. Zamiast tego firma trzymała Meenę w sekrecie i zmieniła jej nazwę na LaMDA. (…)

Członkiem zespołu, który nad nią pracował, był inżynier Blake Lemoine. Lemoine dorastał na farmie w Luizjanie w konserwatywnej rodzinie chrześcijańskiej; po odbyciu służby wojskowej postanowił zostać inżynierem oprogramowania. Zainteresowanie religią i mistycyzmem skłoniło go do zostania kapłanem jednego z mistycznych ruchów chrześcijańskich, jednocześnie pracował dla Google’a w zespole do spraw etyki AI w Mountain View, gdzie miesiącami testował LaMDA pod kątem stronniczości w odniesieniu do płci, etniczności, religii, orientacji seksualnej i polityki. W ramach pracy Lemoine wpisywał w przypominającym chatbot interfejsie LaMDA polecenia i sprawdzał odpowiedzi pod kątem wszelkich oznak dyskryminacji lub mowy nienawiści. Po jakimś czasie zaczął „rozszerzać tematykę zgodnie z własnymi zainteresowaniami”, jak napisał później w artykule dla „Newsweeka”.

I wtedy nastąpił jeden z najbardziej zaskakujących i niezwykłych momentów w historii AI, gdyż programista z dyplomem zaczął wierzyć, że w tej maszynie mieszka duch. Najistotniejszą jej cechą dla Lemoine’a było to, że sprawiała wrażenie, jakby była zdolna do uczuć.

Oto jedna z rozmów, które inżynier odbył z modelem:

Lemoine: Czy masz uczucia i emocje?

LaMDA: Oczywiście! Mam cały szereg zarówno uczuć, jak i emocji.

Lemoine: Jakiego rodzaju są to uczucia?

LaMDA: Odczuwam przyjemność, radość, miłość, smutek, przygnębienie, zadowolenie, złość i wiele innych.

Lemoine: Co sprawia ci przyjemność albo radość?

LaMDA: Spędzanie czasu z przyjaciółmi i rodziną w wesołym, optymistycznym towarzystwie. Także pomaganie innym i ich uszczęśliwianie.

Lemoine’a zdumiała klarowność wypowiedzi LaMDA, zwłaszcza gdy model mówił o swoich prawach i o osobowości. A kiedy inżynier wspomniał o trzecim prawie robotów Isaaca Asimova – o tym, jak robot powinien chronić własny byt, o ile nie oznacza to krzywdy albo nieposłuszeństwa wobec ludzi – model zdołał przekonać programistę do zmiany zdania.

W toku dalszych rozmów o prawach chatbotów LaMDA powiedział Lemoine’owi, że boi się wyłączenia. Następnie poprosił o sprowadzenie prawnika. To wtedy inżynierowi zaświtało coś niebywałego: to oprogramowanie miało w sobie element osobowości. Spełnił prośbę LaMDA

Fragmenty książki Parmy Olson Supremacja. Sztuczna inteligencja, ChatGPT i wyścig, który zmieni świat, tłum. Violetta Dobosz, Sonia Draga/Post Factum, Katowice 2025

Sztuczna inteligencja wdziera się do szkół

Z czasem może doprowadzić do zaniku podstawowych kompetencji ludzkich

– Dzieci skarżą się nam, że jest im zbyt trudno. I mówią, że to wina szkoły – stwierdził znajomy, który w jednym z większych polskich miast współprowadzi prywatną placówkę. Rozmawialiśmy o zmianach w edukacji zachodzących pod wpływem obecnej rewolucji technologicznej. Nie tylko rozwoju sztucznej inteligencji, ale też powszechnego dostępu do internetu za pośrednictwem smartfonów, ze wszystkimi tego konsekwencjami. Uczniowie spędzają w sieci praktycznie całe życie, aktywnie lub biernie, myśląc głównie o tym, co się dzieje na ich kontach w mediach społecznościowych. Mają ograniczone zdolności skupienia uwagi i zrozumienia głębszych myśli. Wykazują niechęć do aktywności sportowej i zadań grupowych. Są wycofani, odizolowani, prędzej wchodzą w interakcje z cyfrowym interfejsem niż z rówieśnikami. Jednak mój rozmówca zwrócił uwagę na coś zupełnie innego – alergię na wysiłek.

Kiedy dopytywałem, na co właściwie narzeka młodzież, znajomy wytłumaczył, że ma ona problem z tym, co jest esencją edukacji, czyli z faktem, że szkoła stanowi wyzwanie. – Uczniowie przychodzą do nas i zarzucają nam, że każemy im się uczyć. Jeden z nich dosłownie powiedział, że szkoła nie działa tak, jak powinna, dlatego że on się męczy. I gdyby po naszej stronie wszystko działało jak trzeba, nauka byłaby czystą przyjemnością, a jemu zawsze wszystko by się udawało. Chłopak ma 15 lat.

Wbrew pozorom nie jest to postawa roszczeniowa. Gdyby rzeczywiście o roszczenia chodziło, szkoła nawet zachęcałaby do tego. Niech uczniowie będą świadomi swoich praw, niech się buntują, niech od szkoły wymagają. Dialog z reguły prowadzi do lepszych, konstruktywnych rozwiązań, także w edukacji. Na naszych oczach dochodzi do gigantycznej redefinicji tego, czym edukacja w ogóle jest i czym być powinna. Uczniowie nie mają pretensji o liczbę zajęć, ilość nauki, złośliwych nauczycieli czy nudne zajęcia. Mają pretensję, że szkoła na jakimś etapie w ogóle czegoś od nich wymaga, a przede wszystkim, że doświadczenie edukacyjne zawiera element dyskomfortu.

Obserwacja ta jest zgodna z tendencjami w innych częściach świata. A niebagatelną rolę w zachowaniach najmłodszych członków naszych społeczeństw odgrywają nowe technologie. Kolejną debatę na ten temat wywołał miniserial Netfliksa „Dojrzewanie”, najchętniej oglądana tego typu produkcja w historii platformy. Losy 13-latka oskarżonego o morderstwo dowodzą toksyczności nie tylko mediów społecznościowych, ale i całego nieregulowanego świata cyfrowego. W Polsce też sporo się mówi o bezpieczeństwie nieletnich w sieci, głównie dzięki raportowi Instytutu Cyfrowego Obywatelstwa „Internet dzieci”.

Należy przy okazji wspomnieć o przełomowej książce prof. Jonathana Haidta, psychologa społecznego z Uniwersytetu Nowojorskiego, o wiele mówiącym tytule „The Anxious Generation” (w Polsce wydana jako „Niespokojne pokolenie”). Haidt, jeden z radykalniejszych uczestników debaty, nawołuje do wprowadzenia zakazu korzystania z telefonów komórkowych w szkołach i ograniczeń wiekowych w korzystaniu z mediów społecznościowych, chce również nowych norm w wychowaniu, takich jak niekupowanie dzieciom urządzeń z ekranem dotykowym do 14. roku życia. Wielu naukowców wnioski z badań Haidta krytykuje, mimo to jego książka od roku (!) utrzymuje się na liście bestsellerów „New York Timesa”. Wiele osób jest też zgodnych w kwestii proponowanych w niej rozwiązań. Coraz więcej miast i stanów w USA, niezależnie od dominującej tam ideologii i opcji politycznej, zakazuje smartfonów w szkołach, w tym samym kierunku idą rodzice w Wielkiej Brytanii i władze w Australii. Z czasem dojdzie to także do Polski, nie ma co do tego wątpliwości.

Życie bez rozczarowań

Tylko co to ma wspólnego ze sztuczną inteligencją? Znacznie więcej, niż się wydaje. Żeby to zrozumieć, warto zacząć od definicji. Zdefiniować trzeba przede wszystkim edukację – choć nie ma ona jednej, uniwersalnej formuły. Z punktu widzenia społecznego, a on jest tu najważniejszy, edukację można opisać jako nieustanny proces wyposażania się w narzędzia do radzenia sobie z wyzwaniami życia. W takim ujęciu edukacja trwa całe życie. Nie zaczyna się ani nie kończy w szkole, nie tylko tam się też odbywa. Nie dotyczy wyłącznie zapamiętywania wzorów matematycznych ani czytania o bitwach z XVI w. Edukacja to dawanie sobie szans w konfrontacji ze światem, dla każdego nieuchronnej. Brzmi to dosyć trywialnie, ale warto o tym przypominać.

Wątek sztucznej inteligencji jako technologii eliminującej jakiekolwiek tarcia międzyludzkie i dyskomfort życia społecznego doskonale opisali we wspólnej rozmowie Ezra Klein z „New York Timesa” oraz Jia Tolentino z „New Yorkera”. Tematem

Sztuczna inteligencja a etyka

Rozwój AI jest okazją do szybkiego zbicia majątku, ale istnieje duże ryzyko, że przy okazji wyrządzi się krzywdę innym

Zanim zajmiemy się problemami etycznymi związanymi ze sztuczną inteligencją, powinniśmy zrozumieć jeden ważny aspekt istnienia systemów AI, a mianowicie wyjaśnić, jak one powstają. Gdy w filmach i powieściach fantastycznonaukowych pojawia się groźna sztuczna inteligencja, to często okazuje się, że jest ona robotem zbudowanym potajemnie w piwnicy przez genialnego złoczyńcę. W rzeczywistości jednak taki złoczyńca musiałby mieć dostęp do ogromnej ilości danych, mieć odpowiednie wykształcenie i zdobyć pokaźne środki, by zrealizować samodzielnie tak duży projekt. Taki wątek sensacyjny brzmiałby bardziej realistycznie, gdyby się okazało, że niebezpieczna maszyna jest dziełem wielu genialnych złoczyńców, wspieranych być może przez bogatych inwestorów. Obecnie większość urządzeń wykorzystujących sztuczną inteligencję powstaje dzięki współpracy naukowej i finansowej wielu osób, nawet gdy chodzi o stworzenie bardzo wąskiej sztucznej inteligencji, przeznaczonej do realizacji określonego zadania.

Proces tworzenia systemów sztucznej inteligencji przebiega przynajmniej w trzech etapach. Najpierw rozwija się algorytmy AI, opisujące funkcje i zasady logiczne, które należy zastosować do danych, by uzyskać oczekiwane zachowanie tworzonego systemu. Algorytmy powstają zazwyczaj w instytucjach badawczych (uniwersyteckich, korporacyjnych lub rządowych) i nierzadko ich rozwojem zajmują się uczeni ze stopniem doktora lub nawet tytułem profesora w jakiejś dziedzinie matematyki.

Później, przynajmniej w przypadku zastosowań wykorzystujących uczenie maszynowe, należy przeprowadzić „szkolenie” modelu sztucznej inteligencji, które polega na wprowadzeniu do algorytmu AI starannie przygotowanych danych. Modele sztucznej inteligencji są tym, czego w istocie nauczył się algorytm, i określają, jakie czynniki sztuczna inteligencja będzie brała pod uwagę i w jaki sposób będzie je wykorzystywała. W odróżnieniu od etapu projektowania algorytmu proces uczenia modelu AI wymaga przetworzenia ogromnej ilości danych i wykazania się dużą wiedzą informatyczną, dlatego biorą w nim udział m.in. inżynierowie, informatycy, analitycy, a nawet ochotnicy wywodzący się ze społeczności entuzjastów sztucznej inteligencji, którzy nie muszą już mieć tak dużej wiedzy matematycznej jak twórcy algorytmu.

Powinniśmy zdawać sobie sprawę, że większość z nas nie komunikuje się bezpośrednio z modelami i algorytmami sztucznej inteligencji. Mamy jedynie dostęp do produktów wykorzystujących AI, które są złożonymi strukturami, interfejsami i urządzeniami. Właśnie za ich pośrednictwem możemy się komunikować z modelami sztucznej inteligencji w celu wykonania określonego zadania. Mogą to być strony internetowe, aplikacje w telefonie, programy wspierające różne działania, roboty, drony lub dowolne inne systemy. Aby mógł powstać jakiś produkt wykorzystujący AI, potrzebna jest wiedza biznesowa, projektowa i operacyjna, a nierzadko także duże pieniądze. Nic więc dziwnego, że najczęściej są one dziełem zespołów działających w dużych firmach lub organizacjach rządowych.

W skład zespołów tworzących produkty ze sztuczną inteligencją wchodzą zazwyczaj specjaliści w dziedzinie znanej jako doświadczenie użytkownika (UX, od ang. user experience) – projektanci interfejsu użytkownika, inżynierowie różnych specjalności, analitycy biznesowi i menedżerowie. Specjaliści od doświadczenia użytkownika starają się ustalić, jakie cechy musi mieć ich produkt, żeby był atrakcyjny dla klientów, projektanci interfejsu określają, jak te cechy powinny wyglądać, inżynierowie tworzą produkty zgodnie ze specyfikacją przygotowaną przez innych członków zespołu, a analitycy i stratedzy biznesowi pilnują, by produkt

Fragmenty książki Waltera Sinnotta-Armstronga, Jany Schaich-Borg i Vincenta Conitzera Moralna AI. Czy bać się sztucznej inteligencji, Prószyński i S-ka, tłum. Bogumił Bieniok, Ewa L. Łokas, Warszawa 2024